Nvidia

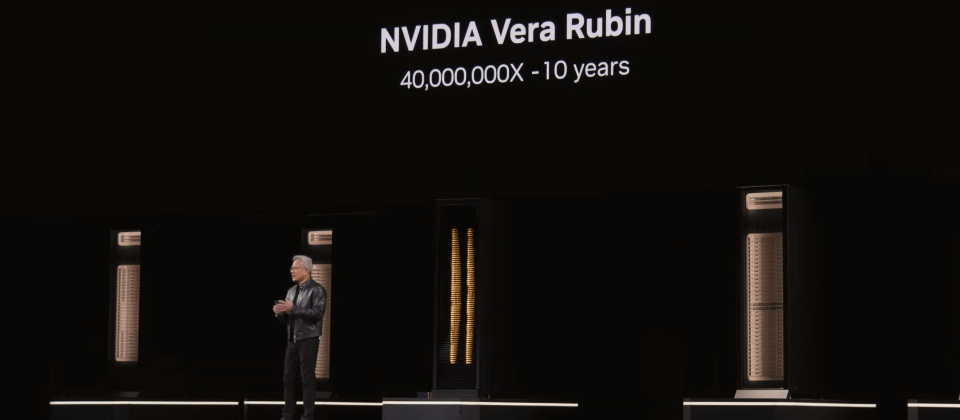

Nvidia在美國聖荷西舉行的GTC 2026大會上,正式發表下一代AI基礎建設Vera Rubin平臺,一系列推出7款晶片,包括Vera CPU、Rubin GPU、NVLink 6高速連結交換器、Blue Field-4DPU、Spectrum-6乙太網路交換器、Connect X-9 SuperNIC及Groq 3 LPU,來打造新一代AI超級電腦,滿足代理式AI的AI工廠需求。

Nvidia執行長黃仁勳形容Vera Rbin為垂直整合,完全與軟體整合延伸到端到端的龐大系統,因為代理AI最重要的工作負載是思考,所需要的大型語言模型會越來越大,產生更多的詞元,快速思考需要對記憶體的存取,以及大量結構、非結構化資料的存取,因此需要全新設計的儲存系統。

.jpeg)

黃仁勳指出,7款晶片、5款機架設計,一個巨大的超級電腦,可驅動AI的每個階段,代理AI的轉捩發展來臨,將由Vera Rubin推動最大規模的AI基礎建設。

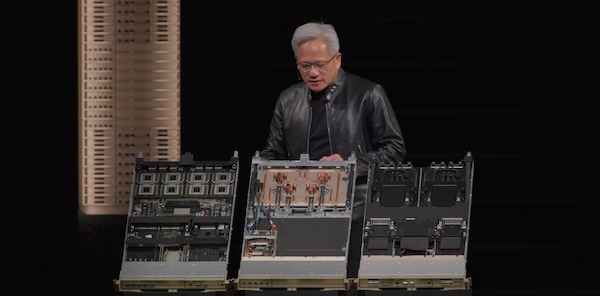

目前7款晶片已經量產,Nvidia還發表採用這些晶片的5款不同功能機架設計,包含Vera Rubin NVL72 GPU 機架、Vera CPU 機架、專門用於推論加速的Groq 3 LPX 機架、BlueField-4 STX儲存機架,還有Spectrum-6 SPX乙太網路機架。

其中Vera Rubin平臺採用百分百的液冷設計,去除複雜的纜線設計,採用45度水溫液冷,有助於減輕資料中心的負荷,降低冷卻資料中心的成本。

Vera Rubin NVL72機架內部整合72顆的Rubin GPU與36顆的Vera CPU,單一GPU可提供50 petaflops的NVFP4運算能力,並配備 HBM4 記憶體。

Vera Rubin NVL72機架搭配NVLink 6高速互連,以及ConnectX-9 SuperNIC、BlueField-4 DPU,來加速運算處理效能。Nvidia強調該機架用於訓練大型混合專家模型時,需要的GPU數量原本Blackwell的平臺的四分之一,Vera Rubin的每瓦推論資料傳送量提升10倍,意謂著每個詞元產生的成本最低可到十分之一。

Vera Rubin NVL72可透過Nvidia Quantum-X800 InfiniBand與Spectrum-X乙太網路擴充GPU,用於打造更多GPU數量的大型AI工廠。

另外,配合AI的快速思考、處理需求,Nvidia發表全新設計的CPU,Vera CPU,內部搭載88 個Nvidia客製化的Olympus核心,強調特別針對強化學習、代理AI的工作負載需要的大量CPU環境而設計。

黃仁勳強調這是專為提高單一執行緒效能而設計的CPU,具有出色的數據處理,極致的每瓦效能表現的能源效率,該CPU具備世上其他CPU兩倍的效能,目前已開始量產,過去Nvidia沒有單獨銷售CPU,現在則開始單獨銷售CPU,這將會是數十億美元的業務。

Vera CPU機架同樣採用液冷設計,其採用MGX架構,內部256顆CPU,這些CPU具有優異的單執行緒效能,並可透過Spectrum X整合多個機架,確保AI工廠內多CPU作業環境同步,搭配GPU機架處理大規模AI工作負載。

Vera Rubin結合LPU,提升兆級參數規模推論資料量及詞元效能

Vera Rubin平臺強調涵蓋AI的不同階段,包括推論,特別是在推論所需的運算效能,推出Groq 3 LPX 機架,推論加速架構針對大型情境、低延遲所設計。其內採用256顆的Groq 3 LPU、128GB SRAM、每秒640TB頻寬,叢集連結後可作為單一處理器來加速推論。

LPX機架搭配Vera Rubin機架,用於處理兆級參數規模的推論資料,每兆瓦推論資料傳輸量可提高至35倍。另外,Rubin GPU與LPU搭配,提升每個詞元的decode效能。LPX機架預計在今年下半年推出。

Vera Rubin機架的進階版則是Rubin Ultra,該平臺採用新的Kiber機架設計,不同於Rubin,Rubin Ultra的運算節點採用垂直插入設計,以提供更高的GPU密度,單一NVLink連接下可達到144個GPU。

至於AI工廠內的儲存方面,Nvidia BlueField-4 STX儲存機架強調專為AI原生設計的儲存架構,特色是將GPU記憶體延伸至整個POD,內部採用CPU與 ConnectX-9 SuperNIC來提高STX的頻寬,以滿足LLM和代理AI工作負載產生的大量KV快取資料,針對儲存和讀取作最佳化。

STX採用專為BlueField DPU設計的DOCA Memos軟體開發框架,強調和通用儲存的設計相比,推論時的資料輸送量提升高達5倍,進而帶來更高的能源效率。

至於AI工廠內網路架構,Nvidia Spectrum-6 SPX乙太網路機架則針對東西向流量設計,可使用Spectrum-X乙太網路或Quantum-X800 InfiniBand,降低機架間的延遲、提高資料傳輸,確保多GPU的同步效率。

該機架採用共同封裝光學元件(Co-Packaged Optics, CPO)的 Spectrum-X 乙太網路光子技術,這項技術將光學引擎與交換器晶片整合在同一封裝內,省去傳統的可插拔光纖收發器,其效益是光學能效比傳統提升高達5倍,韌性也提升10倍。

Nvidia也發表針對Vera Rubin設計的Vera Rubin DSX AI工廠參考設計,高度整合運算、網路、儲存、電力、散熱系統,從架構上來提升資料中心的能效,使AI工廠在穩定運作、擴展且最大化運作時間。

如同黃仁勳多次在不同活動中一再強調的,在AI時代之下,更強大效能的AI基礎建設,將使

AI工廠的產出量愈多,詞元生成速度愈快,代表業者可獲得更多的營收(Revernu)。

Nvidia目前已和Anthropic、Meta、Mistral AI、OpenAI等業者合作,以Vera Rubin訓練更大規模、更強大的模型。該公司也表示,Vera Rubin平臺的相關伺服器,將由HP、Dell、Cisco、聯想等業者推出,華碩、鴻海、技嘉接下來也將會推出相關的系統。

熱門新聞

2026-03-13

2025-06-02

2026-03-14

2026-03-13

2026-03-13

2026-03-13

2025-04-15

2026-03-16